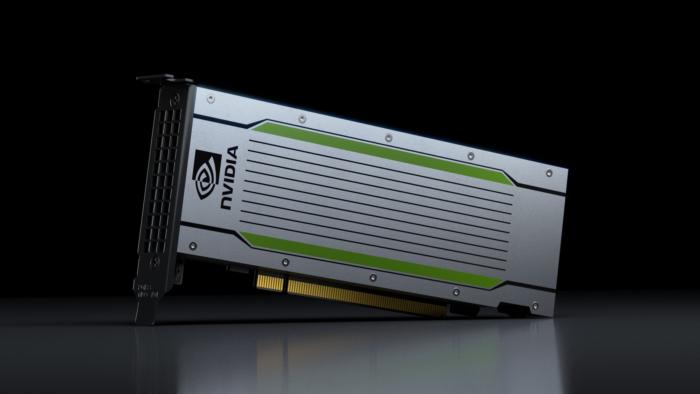

英伟达正在提升其在数据中心的地位,通过特斯拉T4 GPU扩展雷竞技电脑网站其在不同类型人工智能工作负载上的影响力。该GPU基于其新的图灵架构,以及相关软件,为图像、语音、翻译和推荐系统的应用程序设计了极大的加速。

T4是Nvidia新推出的TensorRT Hyperscale推断平台的核心组件。TensorRT是一种小型加速器卡,预计将于第四季度在主要服务器制造商的数据中心系统中上市。

本T4拥有图灵张量核心,它支持不同级别的计算精度不同的AI应用,以及主要的软件框架 - 包括TensorFlow,PyTorch,MXNet,Chainer和Caffe2 - 所谓的深度学习,机器学习涉及多-layered神经网络。

“特斯拉T4是基于图灵架构,我相信将彻底改变AI是如何部署在数据中心,”英伟达CEO詹森黄说,在揭幕周三在东京的公司GTC事件新的GPU和平台。雷竞技电脑网站“张量核GPU是我们的GPU的再造 - 我们决定干脆彻底改造GPU。”

gpu的大规模并行架构使它们非常适合人工智能。Nvidia gpu的并行计算能力加上足够的纯处理能力,使其成为人工智能多年来的首选技术,特别是在机器学习的训练数据集方面——本质上是创建深度学习神经网络模型。

多精度处理是人工智能推理的一个优势

为T4 GPU和新的推理平台前进的一大步是在做基于帕斯卡架构的更多不同的精确度比现有的Nvidia图形处理器P4处理的能力。

一旦神经网络模型的大型数据集的训练,他们被部署到应用程序的推理 - 数据的分类“推断”的结果。虽然训练是计算密集型,在部署了现实世界的应用推理需要尽可能多的灵活性,尽可能从处理器。

理想情况下,为了提高应用速度和功率效率,神经网络的每一层都应该以最不适合该层的精度进行处理。

黄说:“通过创建一种可以混合匹配所有这些混合精度的架构,我们可以将精度和吞吐量最大化,都在75瓦。”他补充说,T4s比P4s至少快8倍,在某些情况下快40倍。

对推理的需求正在迅速增长,因为数据中心已经将处理数十亿语音查询、翻译、图像和视频、推荐和社交媒体雷竞技电脑网站互动的各种应用程序投入生产。英伟达估计,人工智能推理行业有望在未来五年内成长为规模达200亿美元的市场。不同的应用需要不同层次的神经网络处理。

“你不想做的32位浮点运算,如果应用程序需要16位,”帕特里克·摩尔海德,分析公司穆尔洞察与策略的创始人。“Nvidia已经完全成长于新推理平台的数据中心AI了吧。”雷竞技电脑网站

什么是TensorRT超尺度推理平台?

所述TensorRT超大规模推理平台,一个小的75瓦的PCIe形状因子,所述的组件包括:

- Nvidia的特斯拉T4 GPU,具有320个量图灵磁芯和2560 CUDA(计算Unitfied设备架构)内核。CUDA是NVIDIA的编程语言进行并行处理。T4多倍能力包括FP16(16位浮点运算)到FP32,INT8(8位整数运算)和INT16。该T4是能够65万亿次的峰值性能为FP16,130万亿次为INT8和260万亿次为INT4。

- TensorRT 5,推理优化和运行时的深度学习。它被设计用于低延迟,高吞吐量的推理来快速优化,验证并在超大规模数据中心部署的推理训练的神经网络,嵌入式或auotomotive GPU平台。雷竞技电脑网站它支持TensorFlow,MXNet,Caffe2和Matlab框架和其他框架通过ONNX(开放式神经网络交换)。

- 该TensorRT推理服务器,它的Nvidia正在从它的GPU云作为数据中心部署的推论服务器。它的设计,规模化训练和推理部署multicloud GPU集群,并与Kubernetes和泊坞整合,让跨节点的集群开发自动部署,调度和多GPU应用程序容器的操作。

软件支持是关键

“我们正在继续投资和优化我们的整个软件栈的底部,我们这样做通过利用可用的框架,所以每个人都可以运行自己的神经网络交钥匙马上开箱即用的——他们可以训练模型和扭转和部署他们一天,”伊恩·巴克说,副总统的Nvidia的加速计算业务单元。

在AI推理的区域,Nvidia已经看到从FPGA中的制造商(现场可编程门阵列),特别是Xilinx公司的竞争。的FPGA的可编程性让开发人员微调用于不同层次的深层神经网络的计算精度。但是,FPGA已经提出了程序员一个陡峭的学习曲线。自定义的FPGA经硬件描述语言(HDL)多年来所做的那样,而不是用于其他芯片的高级语言。

FPGA提供了竞争的GPU

三月,Xilinx公布了它所谓的新产品类别-自适应计算加速平台(ACAP) -将有更多的软件支持比传统的fpga。ACAP的第一个版本代号为Everest,预计将于明年发布,Xilinx表示,软件开发人员将能够使用C/ c++、OpenCL和Python等工具来使用Everest。使用像Verilog和VHDL这样的HDL工具,Everest也可以在硬件、寄存器转移级别(RTL)上进行编程。

但是T4 gpu提供的软件支持,加上它的多精度能力,似乎注定要加强Nvidia在人工智能培训和推断方面的地位。

“我们相信,我们拥有最高效的推理平台,”巴克说,“我们衡量自己的实际生产负载,我们今天所看到的,并受到广大客户看到的 - 我们我们的堆栈上与他们的工作从上底部以确保我们提供不只是最好的训练,但现在也是最好的推理平台。”

Buck表示,几乎所有目前使用P4 gpu的服务器制造商都将在今年年底推出T4版本。在东京的活动上,包括思科、戴尔EMC、富士通、HPE、IBM、甲骨文和SuperMicro在内的数据中心系统制造商都对T4表示了支持。

此外,谷歌表示将使用新的T4s。