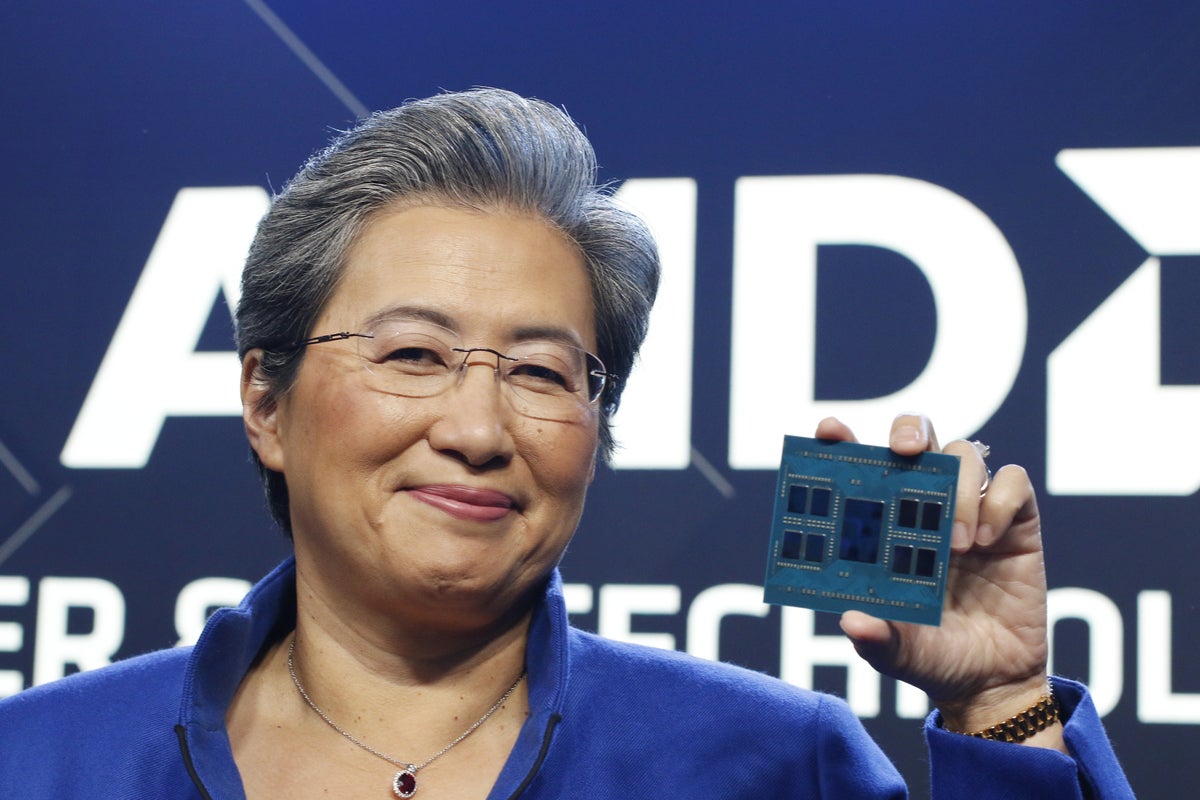

AMD大举投向NvidiaAI处理器启动后,AMD称它能完成多GPU工作

首席执行官Lisa Su调用Instinct MI300X“最复杂的事情我们所造 ”

重达1460亿晶体管Mi300X生成192GB高带宽HBM3存储器,由CPU和GPU共享共有13片死尸芯片内存带宽5.2TB/s,比Nvidia H100快60%

芯片由ZenCPU核心和AMD下一代CDNA3GPU架构组成余量内存实销点

今日看行业时常看到 模型规模开始大得多并实际需要多GPU运行最新大语言模型使用MI300X可以减少GPU数,随着模型规模继续增长,这将变得更加重要多内存多带宽少GPU

AMD表示MI300X设计比现有的MI250X高八倍边界世界最快超级计算机和五倍高节能下年Lawrence Liverore国家实验室将建二加ExaFLOP El Capitan系统

并发布AMDInstinct平台, 服务器参考设计基础为开放计算项目规范, 使用8 MI300XGP

企业和超标器可使用Instinct平台将MI300XGP

并方便地将MI300X安装到现有的AI斜坡服务器构造中

新建云CPU

add讨论四元EPYC 97X4处理器代号Bergamo处理器专为云环境设计,因为它多芯虚拟机运行伯加莫带128核超线程,双套系统可达512虚拟CPU

苏谈云性工作如何产生云中。设计时充分利用新云计算框架,并基本以微服务运行处理器设计不同于通用计算-Bergamo处理器小而面向吞吐量,因此多核心设计

Bergamo利用所有平台基础并支持相同的次元内存 和相同的IO能力容得下设计点扩展至128个核心方位 云中领导性能和节能

MI300X和Bergamo将在第三季度开始采样